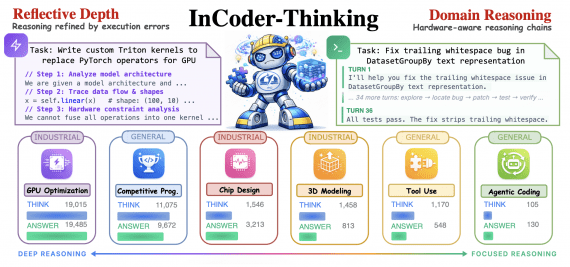

InCoder-32B-Thinking: открытая модель генерации кода для микроконтроллеров, оптимизации GPU-ядер и RTL-проектирования

7 апреля 2026

InCoder-32B-Thinking: открытая модель генерации кода для микроконтроллеров, оптимизации GPU-ядер и RTL-проектирования

Команда исследователей из Пекинского авиационного института, Шанхайского транспортного университета, Университета Манчестера и компании IQuest Research опубликовала InCoder-32B-Thinking — языковую модель с расширенной цепочкой рассуждений (chain-of-thought reasoning) для задач разработки кода…