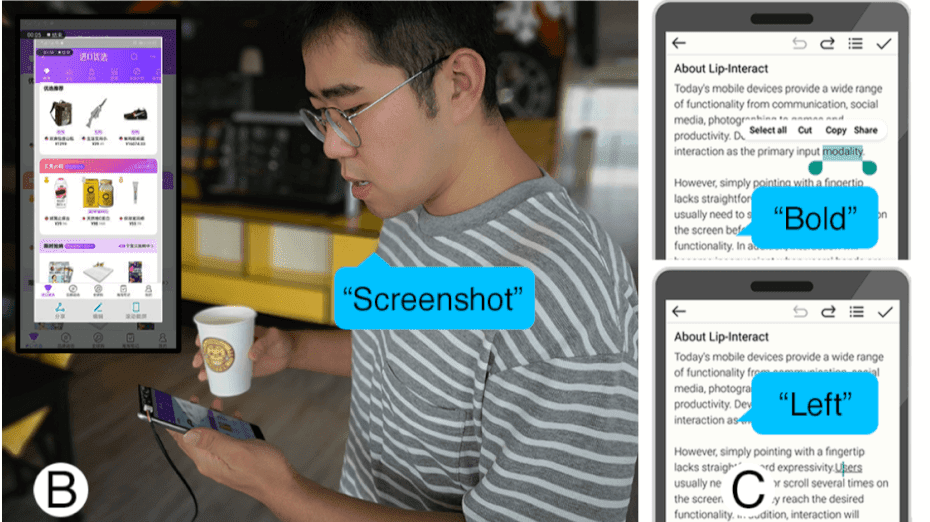

Китайские исследователи из Университета Цинхуа представили Lip-Interact — инструмент, который позволяет смартфону распознавать беззвучные команды по движениям губ. В будущем разработка позволит давать команды помощнику беззвучно, если этого требует ситуация, а также поможет глухонемым людям взаимодействовать с голосовыми помощниками.

Как работает Lip-Interact

Технология использует переднюю камеру смартфона чтобы идентифицировать лицо и распознать 20 точек, которые описывают движения губ пользователя и определяют степень открытия рта для определения начала и завершения команды. Инструмент распознаёт полученные команды с помощью свёрточной end-to-end модели. После того как произошло распознавание команды по движениям губ, модель проводит проверку аудиосигнала с микрофона, чтобы отличить Lip-Interact от обычного взаимодействия. Например, если человек разговаривает с кем-то, губы тоже двигаются, но приложение не станет распознавать эти движения как команду. Чтобы обучить нейронную сеть, исследователи использовали 48 335 образцов видео с движениями губ.

Результаты

На данный момент технология поддерживает распознавание 44 команд для доступа к функциям системного уровня (запуск приложений, изменение настроек, обработка всплывающих окон), а также операции в двух приложениях: WeChat и Notepad. Средняя точность распознавания составляет 95,5%. В дальнейшем разработчики надеются улучшить точность и полностью интегрировать Lip-Interact в смартфон — сейчас для работы технологии используется отдельная камера и компьютер для проведения вычислений.