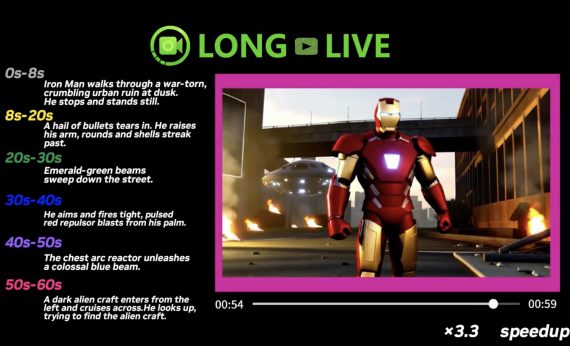

daVinci-MagiHuman: открытая 15B-модель генерирует 5-секундное видео с липсинком за 2 секунды на одном H100

24 марта 2026

daVinci-MagiHuman: открытая 15B-модель генерирует 5-секундное видео с липсинком за 2 секунды на одном H100

Команды SII-GAIR и Sand.ai опубликовали daVinci-MagiHuman — открытую мультимодальную 15B-модель на основе однопоточного трансформера, которая одновременно генерирует видео с липсинком и синхронное аудио и создает 5-секундный клип в 256p за…