Google Brain разработали MLP-Mixer, архитектуру компьютерного зрения на основе многослойных перцептронов

11 мая 2021

Google Brain разработали MLP-Mixer, архитектуру компьютерного зрения на основе многослойных перцептронов

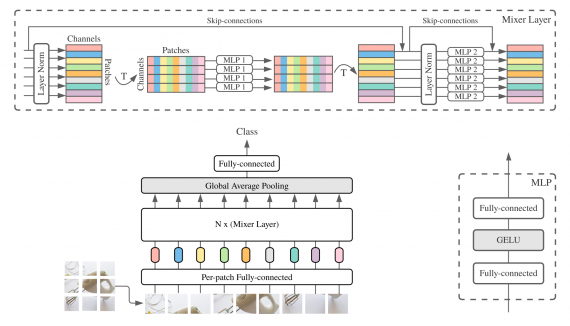

MLP-Mixer — архитектура от Google Brain, которая показала высокие результаты в компьютерном зрении, используя только линейные слои. Является сопоставимой альтернативой свёрточным нейросетям и трансформерам. Код доступен на Github. Зачем это…