LIT — это опенсорс визуальный и интерактивный инструмент для интерпретации NLP-моделей.

Подробнее про библиотеку

Функционал LIT позволяет ответить на такие вопросы, как:

- Для каких объектов данных модель выдает неточные предсказания;

- Почему модель сделала отдельное предсказание;

- Можно ли отнести отдельное предсказание к нежелательным искажениям в обучающей выборке;

- Насколько устойчива модель к изменению текстового стиля, формы глагола или рода у местоимения

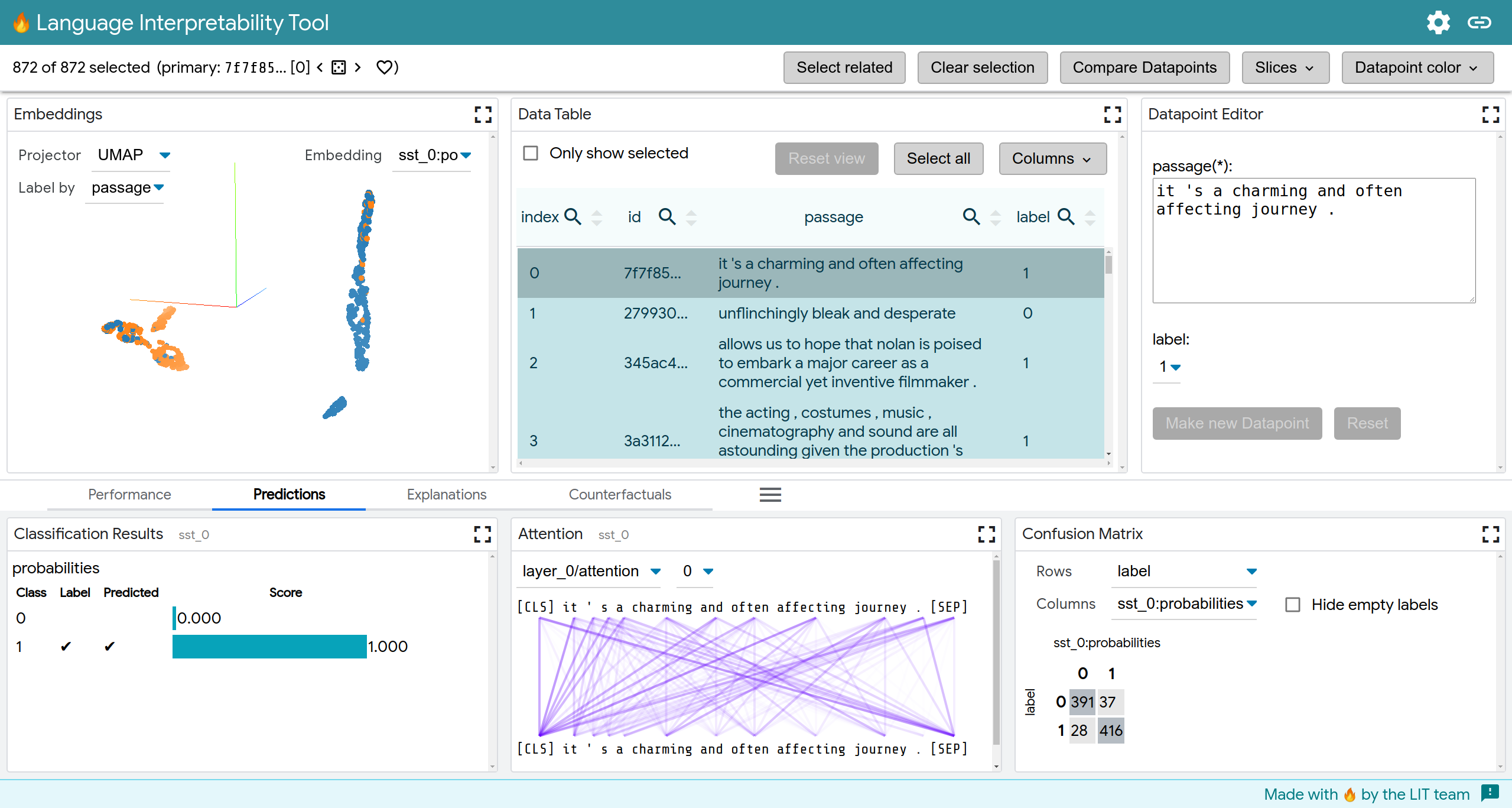

LIT поддерживает набор методов для дебаггинга через пользовательский интерфейс в браузере. Техники включают в себя:

- Локальные объяснения через salience карты, распределение внимания и визуализацию предсказаний модели;

- Аггрегация анализа, который может включать в себя кастомные метрики, разрезы и визуализацию пространства эмбеддингов;

- Динамическая оценка предсказаний для новых объектов данных;

- Режим для сравнения двух и более моделей или одной модели на паре примеров;

- Масштабирование на новые типы моделей, как классификация, регрессия, разметка спанов, seq2seq и языковая модель;

- Поддержка моделей с несколькими механизмами внимания и несколькими входными признаками;

- Отсутствие зависимости от фреймворка. Поддерживает TensorFlow, PyTorch и другие