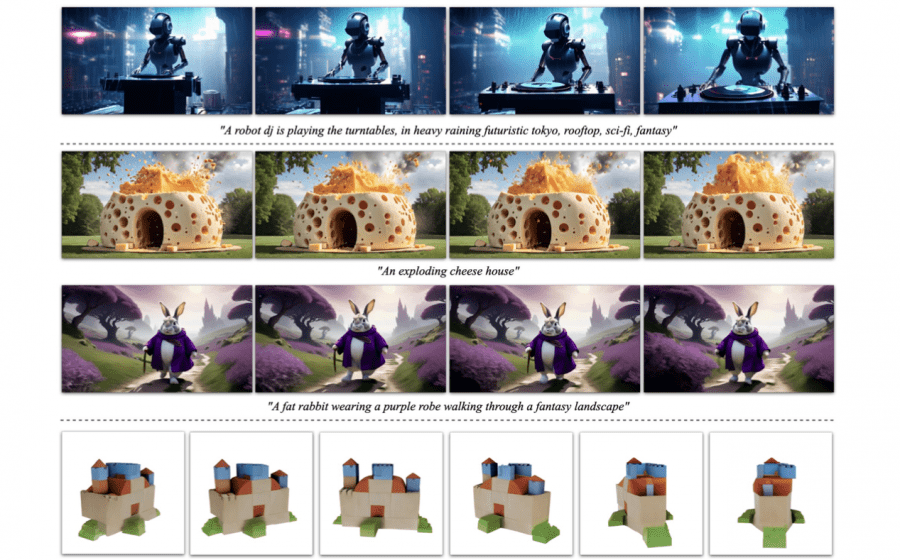

Компания Stability AI объявила о выпуске Stable Video Diffusion – набора из двух моделей, генерирующих видео продолжительностью до 4 секунд по входному изображению. Обе модели опубликованы в открытом доступе.

Модели SVD и SVD-XT разрешается использовать только для исследовательских целей. По итогам сбора обратной связи от пользователей Stability AI планирует доработать их для коммерческого применения.

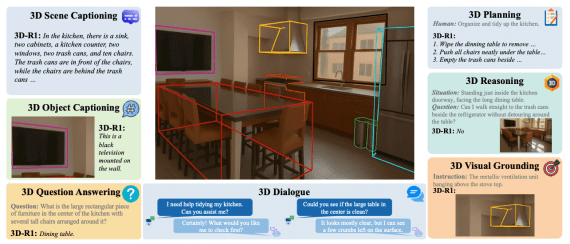

SVD и SVD-XT – модели скрытой диффузии, которые используют статичное изображение в качестве первого кадра и генерируют из него видео разрешением 576×1024. Обе модели генерируют контент со скоростью от трех до 30 кадров в секунду. Модель SVD была обучена создавать 14 кадров из изображения, а SVD-XT – 25 кадров.

Для обучения использовался датасет из 600 млн общедоступных видео, а для точной настройки на прогнозирование последовательности кадров – меньший датасет (1 млн видео) более высокого качества.

По результатам внешнего опроса выходные результаты SVD оказались превосходящими ведущие закрытые модели преобразования текста в видео от Runway и Pika Labs. Stability AI в качестве основных сфер приложений Stable Video Diffusion называет рекламу, образование и развлечения. В планах компании – добавить поддержку текстовых запросов.

Код моделей доступен на GitHub, а их веса — на Hugging Face.