FLM-101B: языковую модель со 101 миллиардом параметров обучили с нуля «всего» за $100 000

24 сентября 2023

FLM-101B: языковую модель со 101 миллиардом параметров обучили с нуля «всего» за $100 000

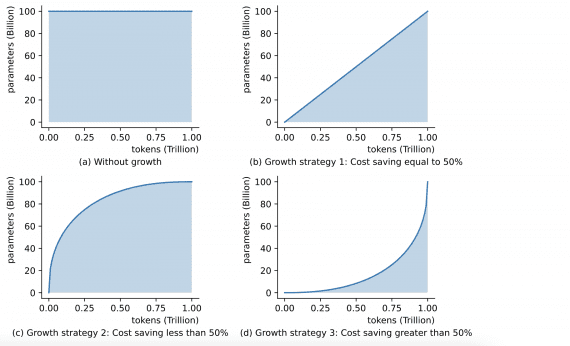

Исследователи из Пекинского университета представили FLM-101B — открытую большую языковую модель с 101 миллиардом параметров, обученную с нуля на 300 миллиардах токенов при затратах «всего лишь» $100 000. Обучение таких…