Исследователи из Binghampton University и Intel Corporation разработали модель, которая распознает дипфейки по предсказанному сердцебиению. Классификатор использует данные фотоплетизмограмм для распознавания фейковых видео. Важным допущением в модели является то, что она обучается распознавать дипфейки, которые были сгенерированы с помощью набора публично доступных архитектур. Это накладывает ограничения на использование модели в реальных приложениях. Подход детектирует фейковые видео с точностью 97.27% и генеративную модель дипфейков — с точностью в 93.39%.

В чем проблема

Популярность дипфейков растет за последние годы возросла. Искусственно сгенерированные видео с знаменитыми людьми используются для разных целей: от фильтров на изображения в социальных сетях до политической пропаганды и ложных новостей. Это делает исследования методов по распознаванию дипфейков актуальным направлением.

Подробнее про модель

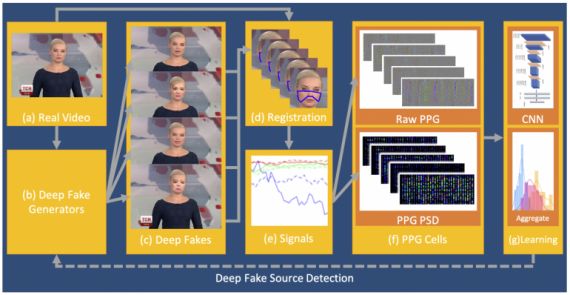

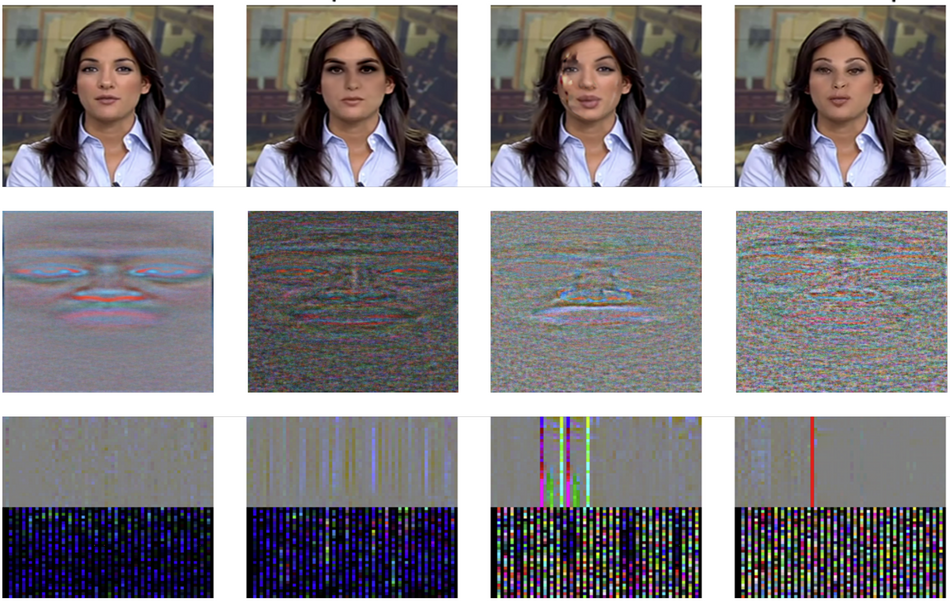

Исследователи проанализировали остатки из генеративной GAN модели и пытались связать их с биологическими сигналами. Предложенный фреймворк для классификации дипфейковых видео способен распознать фейковое видео и его источник, если оно было сгенерировано одной из доступных моделей.

Модель начинает с нескольких генеративных сетей, которые получают на вход одно реальное видео. Реальное видео и сгенерированные дипфейки затем поступают на вход модулю регистрации. На этом этапе модель извлекает интересующие части лица, по которым отслеживают биологические сигналы для фотоплетизмограмм. Последний модуль — это классификатор, который предсказывает класс видео по представлению. Если модель предсказала дипфейк, то затем она предсказывает наиболее вероятную архитектуру модели, которую использовали для генерации.