FBNet — это архитектура сверточной нейросети, которая была автоматически разработана с помощью метода для оптимизации архитектуры модели. Исследователи опубликовали дифференцируемый метод для поиска архитектуры — DNAS. Differential Neural Architecture Search основывается на градиентных методах для оптимизации архитектуры сверточной нейросети. DNAS адаптирует структуру нейросети под тип устройства, на котором она будет запускаться.

Разработка эффективных и точных сверточных нейросетей для мобильных устройств — это сложная задача из-за того, что широко пространство возможных архитектур. Из-за размера пространства предыдущие методы для поиска архитектуры нейросети вычислительно дорогие. Оптимальность архитектуры сверточной сети зависит от таких факторов, как разрешение входных данных и тип мобильного устройства. Предыдущие методы слишком ресурсоемкие, чтобы переделывать дизайн под отдельные кейсы. Исследователи используют DNAS, чтобы избавиться от ограничений предыдущих подходов. DNAS оптимизирует архитектуру нейросети с помощью методов, основанных на градиентах. При этом в DNAS рассматриваемые архитектуры не тренируются отдельно, как в предыдущих методах.

Как работает DNAS

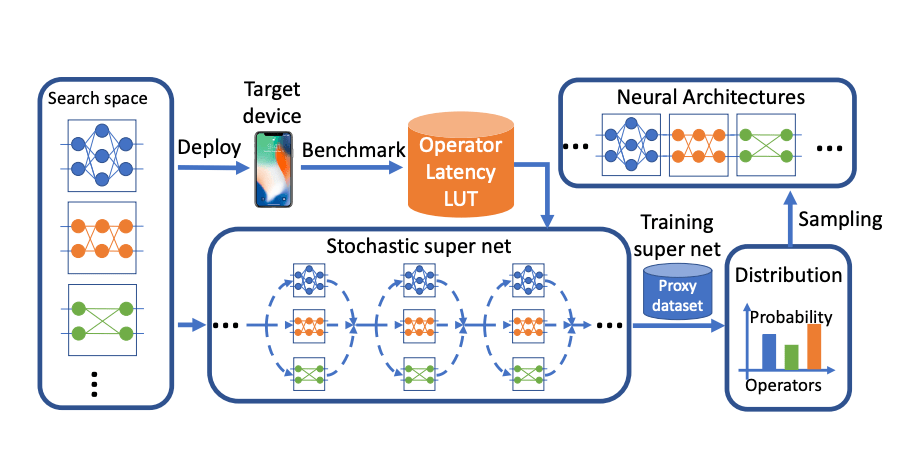

DNAS исследует пространство на уровне слоев. Каждый слой в сверточной нейросети может выбрать разный тип блока. Пространство поиска представляется с помощью стохастической super net. Процесс поиска обучает стохастическую главную сеть с помощью SGD. Это необходимо, чтобы оптимизировать распределение архитектур. Оптимальные архитектуры отбираются из обученного распределения.

Как работают FBNets

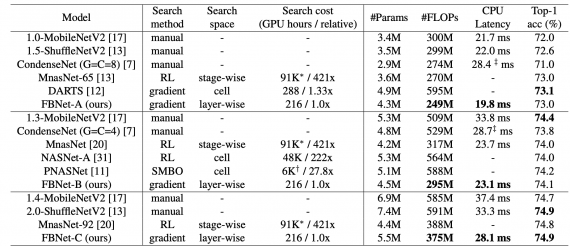

FBNets — это семейство сверточных моделей, которые выдал DNAS алгоритм. Модели обходят state-of-the-art нейросети, как разработанные вручную, так и те, чья структура была оптимизирована автоматически. FBNet-B достигает точности в 74.1% на ImageNet с задержкой в 23.1 миллисекунд на Samsung S8 phone. Модель в 2.4 раза меньше и в 1.5 быстрее, чем MobileNetV2-1.3 с схожей точностью. Несмотря на высокую точность и небольшую задержку у MnasNet модели, ресурсов на поиск архитектуры FBNet-B затратили в 420 раз меньше. Общее число GPU часов составило 216. FBNets достигают точности от 1.5% до 6.4% выше, чем MobileNetV2.