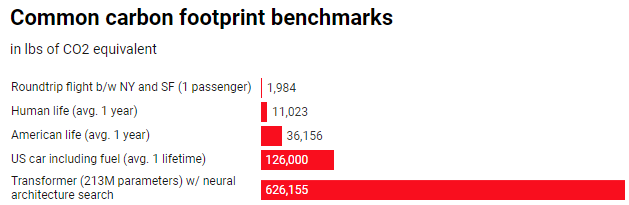

Исследователи из Массачусетского университета в Амхерсте обнаружили, что в процессе жизненного цикла обучения распространенных крупных моделей ИИ может быть выделено более 626 000 фунтов в эквиваленте углекислого газа, что почти в пять раз превышает срок службы среднего американского автомобиля (включая производство самого автомобиля).

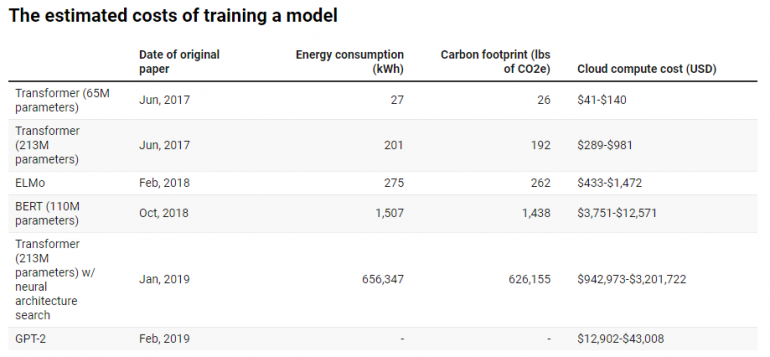

В статье, опубликованной исследователями, рассматривается процесс обучения модели для обработки естественного языка (NLP), направления ИИ, которое фокусируется на обучении моделей для работы с человеческим языком. Исследователи рассмотрели четыре модели в этой области, которые были ответственны за самые большие скачки в производительности: Transformer, ELMo, BERT и GPT-2. Они обучали каждую из них на одном GPU до одного дня, чтобы измерить потребляемую мощность. Затем они тратили столько часов обучения, сколько было указано в оригинальных документах к моделям, для расчета общей энергии, потребляемой за весь процесс обучения. Это число было пересчитано в фунты эквивалента углекислого газа на основе среднего энергопотребления в США, которое близко соответствует энергопотреблению, используемому Amazon AWS, крупнейшим поставщиком облачных услуг.

Они обнаружили, что вычислительные и экологические затраты на обучение росли пропорционально размеру модели, а затем увеличивались при использовании дополнительных шагов настройки для повышения конечной точности модели. В частности, они обнаружили, что поиск нейронной архитектуры, который пытается оптимизировать модель путем постепенной настройки гиперпараметров нейронной сети путем проб и ошибок, имеет чрезвычайно высокие сопутствующие затраты при небольшом выигрыше в производительности. Без этого самая «дорогая» модель, BERT, имела углеродный след примерно 1400 фунтов в эквиваленте углекислого газа, что близко к перелету туда и обратно на трансамериканском рейсе для одного человека.

Эти расчеты исходят только из обучения одной, финальной модели. Однако, на практике, прежде, чем получить финальную модель, которая лучшим образом выполняет свою задачу, происходит обучение еще десятков, сотен или даже тысяч моделей. Эмма Струбелл, ведущий автор статьи, сообщила, что на примере их предыдущей статьи, было обнаружено, что процесс создания и тестирования окончательной модели, достойной научной статьи, потребовал обучения 4789 моделей в течение шестимесячного периода.

Результаты статьи подчеркивают еще одну растущую проблему ИИ: огромная интенсивность ресурсов, необходимых в настоящее время для получения результатов, достойных научных статей.