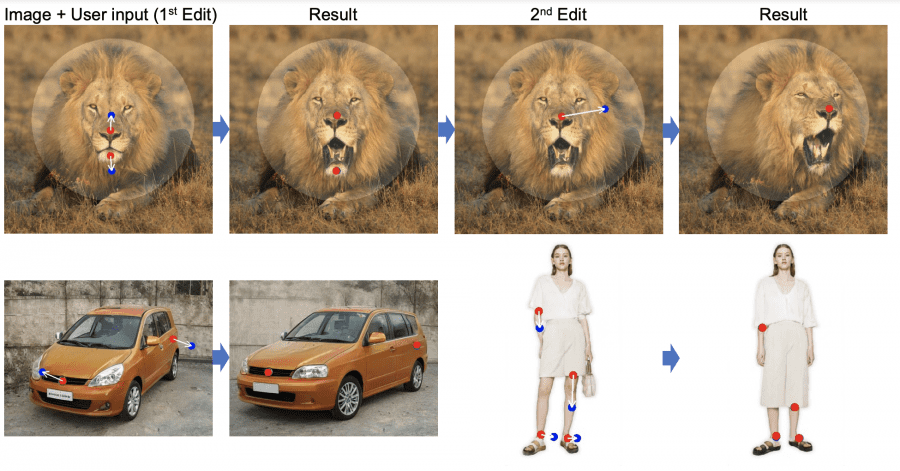

Исследователи из Института Макса Планка, MIT и Google представили подход DragGAN для манипуляции содержимым изображений, созданных с помощью GAN. Достаточно расставить несколько опорных и целевых точек на изображении, и модель переместит опорные точки для соответствия целевым точкам. При желании можно использовать бинарную маску, чтобы оставить часть изображения неизменным.

DragGAN деформирует изображение с точным контролем смещения пикселей, позволяя манипулировать позой, формой, выражением лица и композицией объектов: животных, автомобилей, людей, природных явлений.

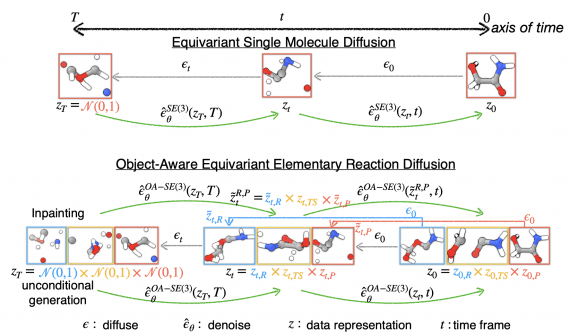

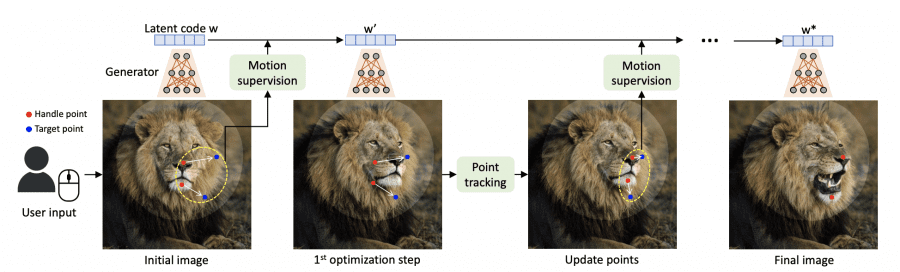

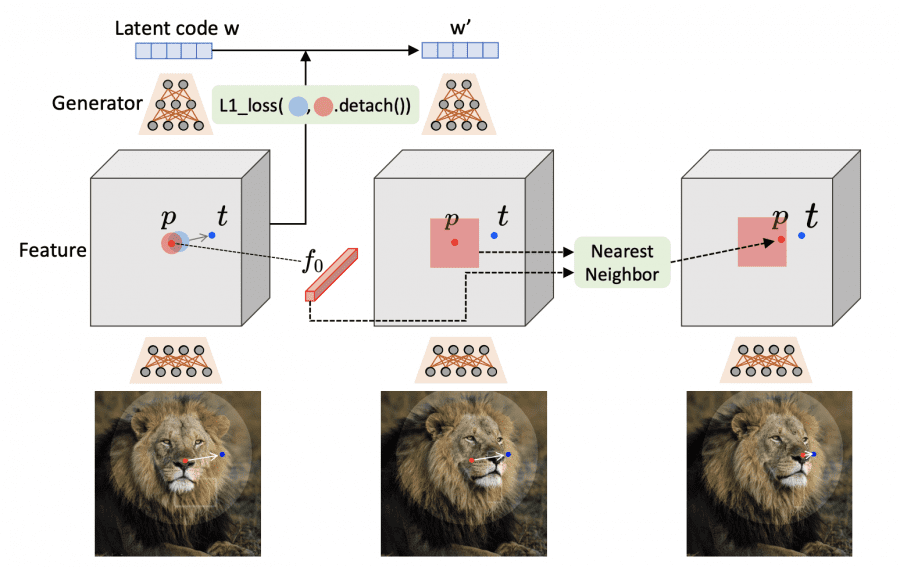

DragGAN состоит из двух основных компонентов:

- Motion supervision: основанная на признаках модель смещения, которая направляет опорные точки (красные точки) к целевым позициям (синие точки).

- Point tracking: новый подход к отслеживанию точек, который использует дискриминативные признаки GAN для постоянной локализации позиции опорных точек.

Подробнее о методе

Для любого изображения I ∈ R^3×H×W, сгенерированного GAN с кодом латентности 𝒘, предусмотрена возможность указать несколько опорных точек {𝒑𝑖 = (𝑥𝑝,𝑖, 𝑦𝑝,𝑖)|𝑖 = 1, 2, …, 𝑛} и соответствующие им целевые точки {𝒕𝑖 = (𝑥𝑡,𝑖, 𝑦𝑡,𝑖)|𝑖 = 1, 2, …, 𝑛} (то есть 𝒕𝑖 является целевой точкой для 𝒑𝑖). Цель заключается в перемещении объекта на изображении таким образом, чтобы семантические позиции опорных точек (например, нос и челюсть на рисунке выше) достигли своих соответствующих целевых точек. Также пользователю предоставляется возможность дополнительно нарисовать бинарную маску M, обозначающую область изображения, которая может быть перемещена.

Метод итеративно выполняет контроль движения и отслеживания точек. Этап контроля движения направляет опорные точки (красные точки) к целевым точкам (синие точки), а этап отслеживания точек обновляет опорные точки, чтобы они следовали за объектом на изображении. Этот процесс продолжается, пока опорные точки не достигнут своих соответствующих целевых точек.

Основная идея контроля движения заключается в том, что промежуточные признаки генератора заметно выделяются, поэтому достаточно простой потери. Конкретно, авторы используют карты признаков F после 6-го блока StyleGAN2, которые показывают лучшие результаты среди всех признаков.

Отслеживание точек происходит в том же пространстве признаков с использованием метода ближайших соседей.

Результаты DragGAN

Манипуляции приводят к реалистичным результатам, даже в сложных сценариях, таких как воссоздание скрытого содержимого и деформация форм, соответствующих гибкости объекта. Качественное и количественное сравнение подтверждает преимущества DragGAN перед предыдущими подходами в задачах манипуляции изображениями и отслеживания точек.

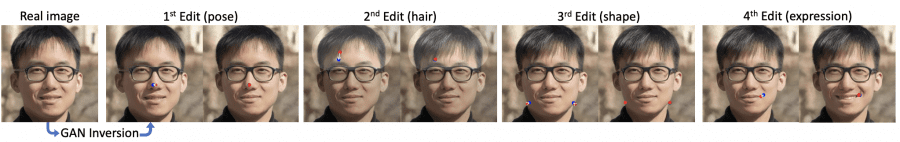

Авторы исследования продемонстрировали возможность манипулировать реальными изображениями. На реальном изображении применяется инверсия GAN для отображения его в латентном пространстве StyleGAN, после чего производится редактирование позы, волос, формы и выражения.

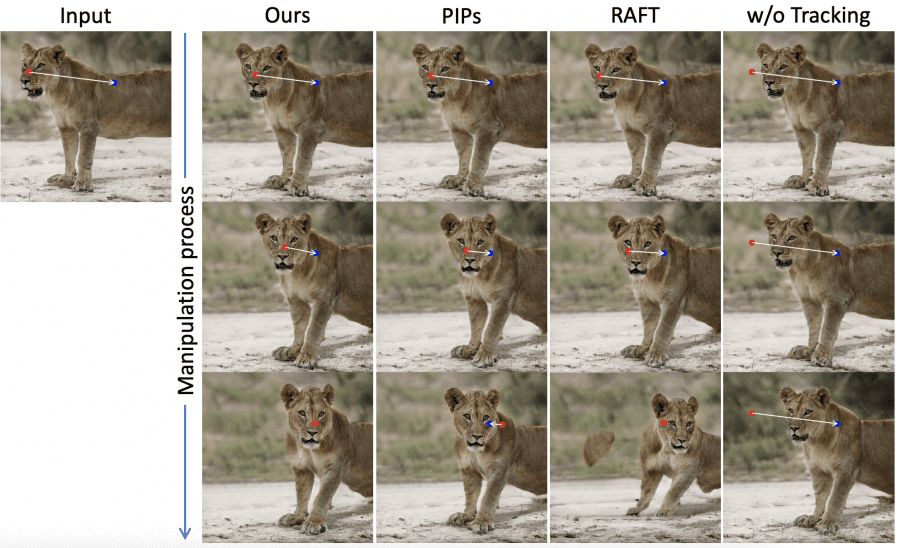

Качественное сравнение DragGAN с методами RAFT, PIPs и без трекинга.

Предложенный метод более точно отслеживает точку смещения по сравнению с базовыми методами, что позволяет добиться более точного редактирования.