Trinity-Large-Thinking 400B: масшабная открытая reasoning-модель для агентных задач стоит в 28 раз дешевле Claude Opus-4.6

3 апреля 2026

Trinity-Large-Thinking 400B: масшабная открытая reasoning-модель для агентных задач стоит в 28 раз дешевле Claude Opus-4.6

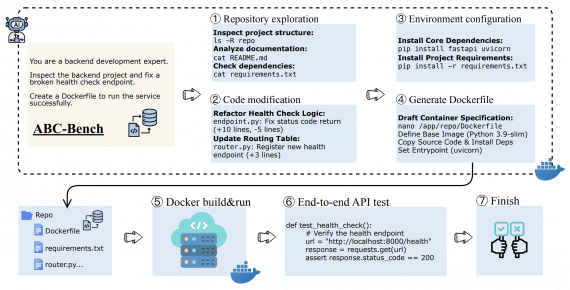

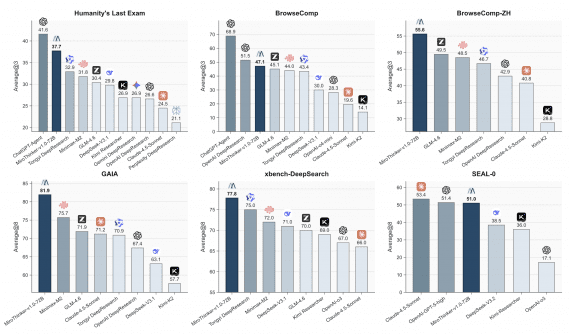

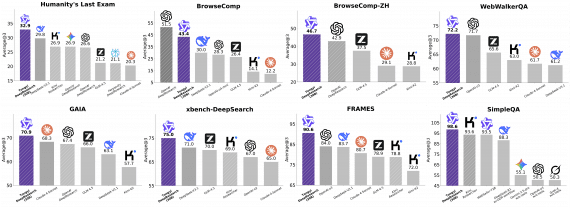

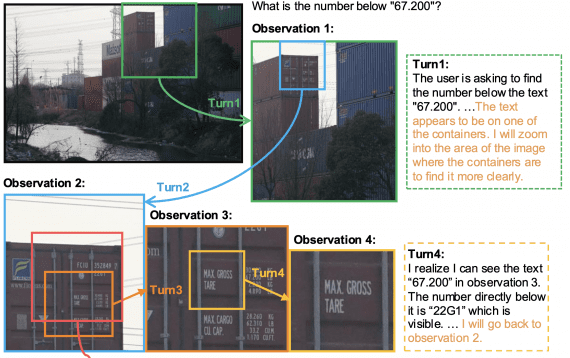

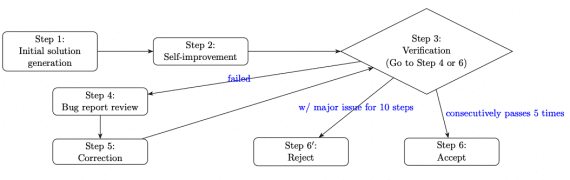

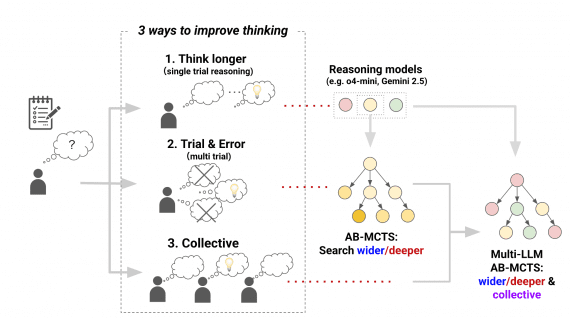

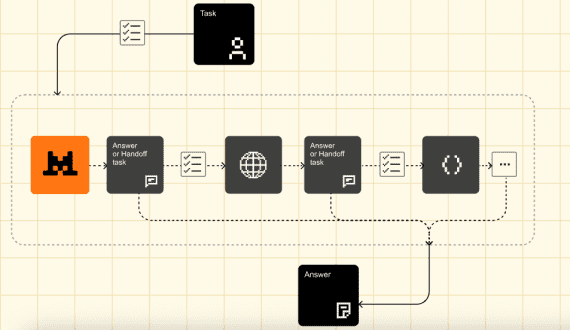

Компания Arcee AI выложила в открытый доступ Trinity-Large-Thinking — модель с рассуждениями для сложных многоходовых агентных задач. На PinchBench — главном бенчмарке для агентных задач — она занимает второе место…