Исследователи MIT представили PhotoGuard – алгоритм защиты изображений от несанкционированных изменений генеративными моделями, позволяющий гарантировать подлинность изображений.

Широкое распространение генеративных моделей (таких, как DALL-E и Midjourney) сделало простым даже для обычных пользователей создание высококачественных изображений и их модификацию с помощью текстовых запросов на естественном языке. Злоумышленники могут использовать такие модели для фальсификаций, потенциально несущих репутационные, финансовые и юридические риски.

PhotoGuard решает данную проблему с помощью возмущений — незначительных изменений пикселей, невидимых человеческому глазу, но влияющих на результат работы моделей. Эти возмущения эффективно нарушают способность модели манипулировать изображениями.

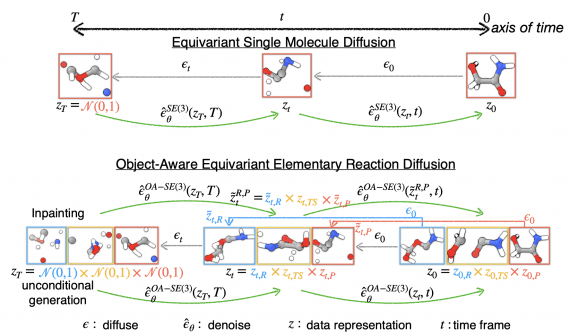

PhotoGuard использует две различные стратегии для внесения возмущений. В более простой стратегии (которую авторы называют «кодирование») изменение пикселей влияет на скрытое представление изображения, заставляя генеративную модель воспринимать изображение как случайный шум. В результате любая попытка манипулировать изображением с помощью моделей становится практически невозможной. Внесенные изменения настолько незначительны, что незаметны человеческому глазу, что позволяет сохранить визуальную целостность изображения и одновременно обеспечить его защиту от редактирования.

Вторая стратегия («диффузия») формирует возмущения таким образом, чтобы изображение казалось модели похожим на совершенно другое («целевое») изображение, отличающееся от того, что воспринимает человеческий глаз. Поэтому при модификации модель вносит изменения в «целевое» изображение, тем самым защищая исходное изображение от фальсификации.

На текущий момент «диффузия» требует гораздо больших вычислительных затрат, чем «кодирование», однако ученые считают, что в будущем смогут оптимизировать данную стратегию.