Когда нейросеть обучается высокоуровневой задаче, как классификация места или генерация сцены, отдельные юниты нейронов в сети часто отвечают за интерпретируемые для человека концепты. Например, деревья, окна или человеческие лица. Однако на данный момент задача анализа частей модели остается актуальной.

Чтобы решить задачу анализа нейросетей, исследователи рассматривают две нейросети, которые содержат интерпретируемые части:

- Сети, которые обучались классифицировать изображения сцен с учителем;

- Сети, которые обучались генерировать изображения сцен (GAN)

Анализ частей классификатора и генератора

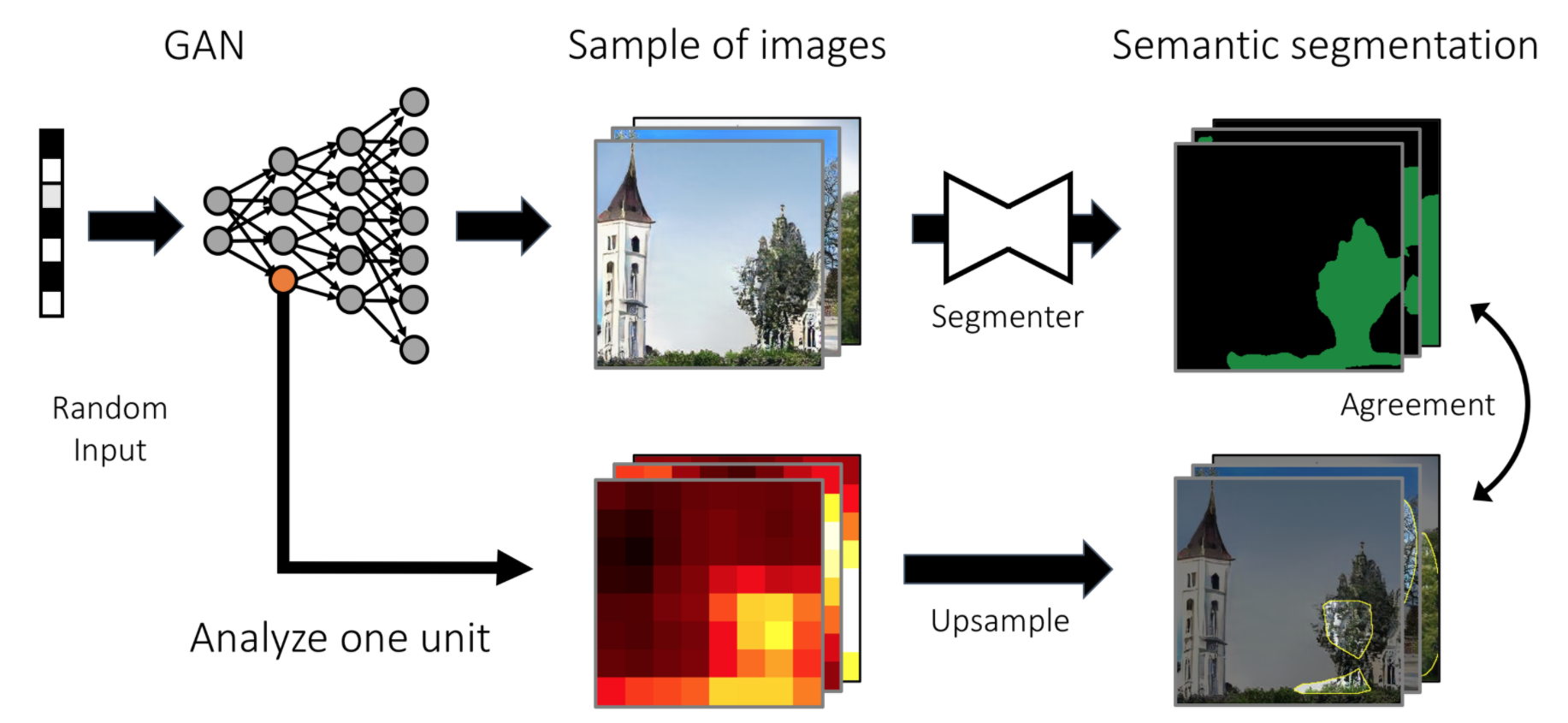

Чтобы распознать юниты, которые отвечают за понятные человеку концепты, исследователи сравнивают выходы юнитов с выходами модели семантической сегментации, которая была обучена размечать пиксели классами объектов, частей, материалов и цветов. Этот метод называется вскрытием сети (network dissection). Он позволяет стандартизировать и масштабировать процесс поиска частей модели, которые принадлежат к одинаковым семантическим классам.

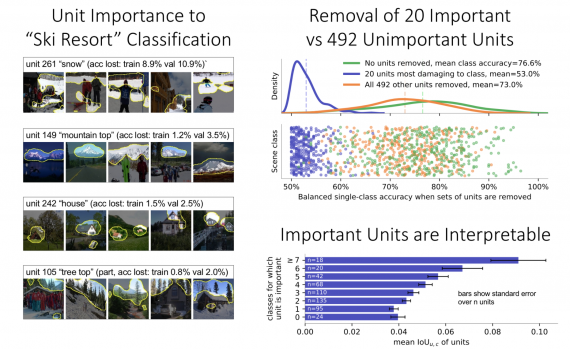

Анализ применим для классификации, когда изображение поступает на вход модели, и для генеративной сети, когда изображение выдается на выходе модели. Метод вскрытия сети позволяет квантифицировать и сравнить семантику юнитов нейронов между разными слоями и разными сетями. Исследователи нашли, что state-of-the-art GAN архитектуры и классификаторы содержат юниты, отвечающие за какие-то отдельные объекты.

Подробнее про процесс анализа частей нейросети — в оригинальных статьях.

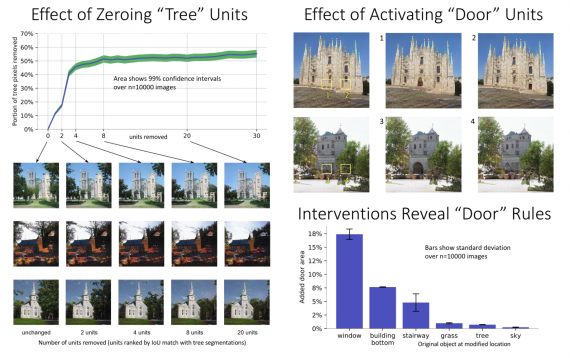

Ниже пример использования знаний о том, за что ответственны разные части GAN.