Исследователи из Google AI обучили модели предсказывать точность нейросетей по их параметрам. Для обучения моделей они собрали параметры 80 тысяч сверточных нейросетей, которые обучили на 4 датасетах по классификации изображений. В качестве предикторов использовались сами веса моделей и статистики по ним. Исследователи нашли, что существуют предикторы, которые способны проранжировать нейросети, обученные на других датасетах или с использованием других архитектур.

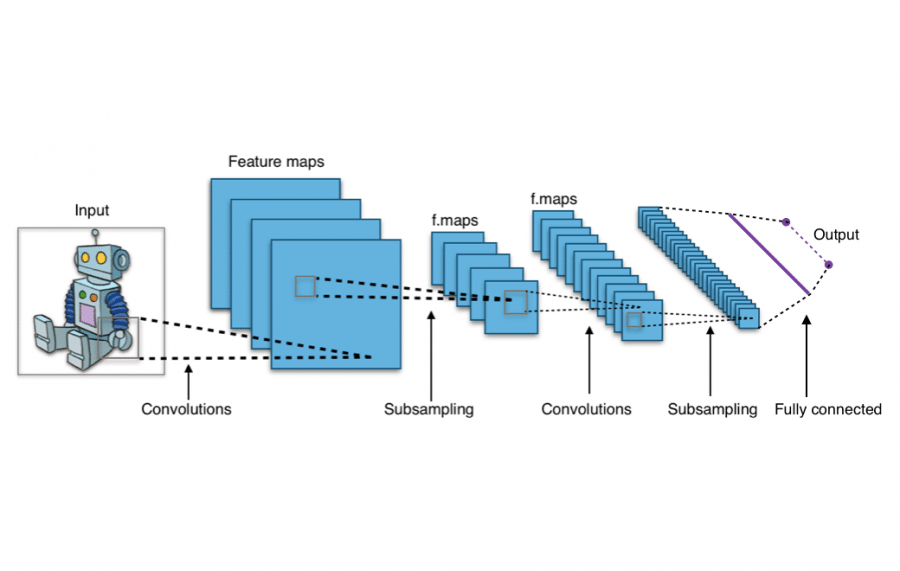

Для предсказания точности нейросетей использовались только веса нейросетей из обучающей выборки в чистом виде и статистики по ним. Нейросети в обучающем датасете состояли из вариаций сверточных нейросетей (CNNs), которые обучили на крупных датасетах для компьютерного зрения. Целью работы было понять, есть ли в параметрах обученных нейросетей паттерны, которые влияют на качество предсказаний.

Тренировочные данные или Зоопарк CNN моделей

Исследователи использовали архитектуры одного размера: 3 сверточных слоя, в каждом из которых по 16 фильтров, за которыми следует global average pooling и полносвязный слой. Всего в каждой модели из выборки 4,970 параметров. Наибольшая точность предсказаний на датасетах CIFAR10 и SVHN была 55% и 75%. Стоит отметить, что такие результаты далеки от текущего state-of-the-art.

Модели из выборки обучали на 4 датасетах для классификации изображений:

- MNIST;

- Fashion MNIST;

- CIFAR10-GS;

- SVHN-GS

Для каждого датасета исследователи случайно семлировали 20 тысяч разных конфигураций гиперпараметров. Среди них — learning rate, тип инициализации весов и их дисперсия, процент обучающих примеров, функция активации, дропаут и регуляризация. Всего датасет состоит из параметров 80 тысяч обученных сверточных нейросетей.

Предсказательные модели

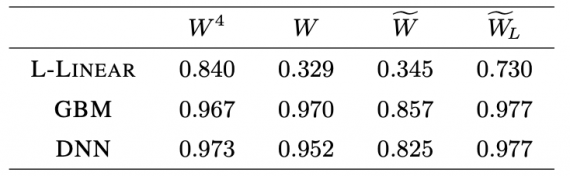

Чтобы научиться предсказывать точность нейросетей, исследователи протестировали три модели:

- Логистическую линейную модель (L-Linear);

- Градиентный бустинг с регрессионными деревьями (GBM);

- Полносвязную глубокую сеть

Каждая модель училась так, чтобы минимизировать среднеквадратичную ошибку (MSE).

Оценка результатов моделей

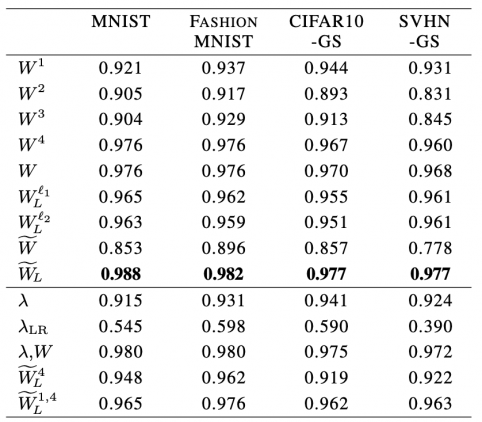

Исследователи отдельно протестировали, как модели предсказывают точность нейросетей. Ниже видно результаты работы GBM для нейросетей, обученных на разных датасетах.