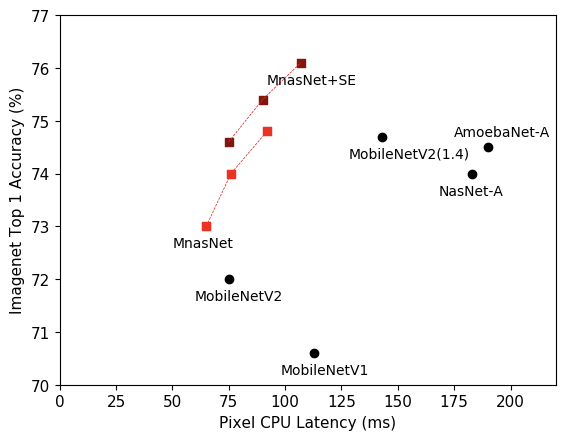

Google разработали подход к выбору нейронной архитектуры, который позволяет достигать рекордной точности и скорости моделей на мобильных устройствах. Выбранные архитектуры работают в 1,5 раза быстрее, чем MobileNetV2, и в 2,4 раза быстрее, чем NASNet.

Разработка CNN для мобильных устройств — сложная задача, поскольку мобильные модели должны быть небольшими и быстрыми, но при этом точными. В блоге команда описывает автоматизированный алгоритм MnasNet, который подбирает архитектуру нейронной сети, используя обучение с подкреплением и учитывая ограничения в скорости работы мобильных устройств. MnasNet исследует работу моделей на определённом смартфоне (в исследовании использован Google Pixel) и измеряет их реальную производительность, автоматически выбирая лучшую архитектуру.

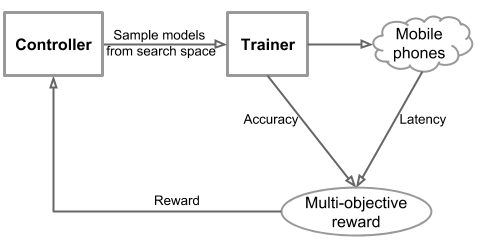

В основе системы три компонента: контроллер RNN для обучения и моделирования архитектуры; тренер, для генерации и обучения моделей, и движок вывода, основанный на TensorFlow Lite, для измерения скорости работы модели на мобильном устройстве.

Команда протестировала выбранные архитектуры на датасетах ImageNet и COCO. Модели работают в 1,5 раза быстрее, чем MobileNetV2, и в 2,4 раза быстрее, чем NASNet, который тоже использует автоматизированный поиск. На COCO нейросети достигли как «более высокой точности, так и более высокой скорости» в сравнении с MobileNet, и сопоставимой точности при вычислительной мощности в 35 раз меньше по сравнению с моделью SSD300.