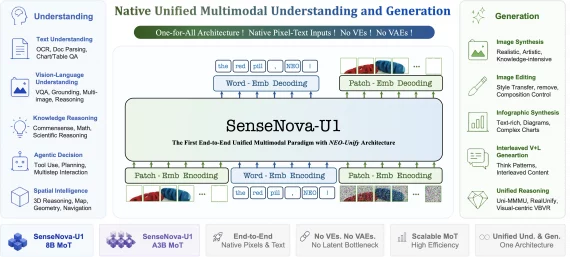

SenseNova-U1: мультимодальная архитектура NEO-unify работает напрямую с пикселями без VAE

14 мая 2026

SenseNova-U1: мультимодальная архитектура NEO-unify работает напрямую с пикселями без VAE

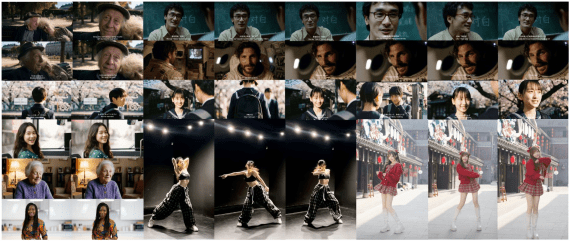

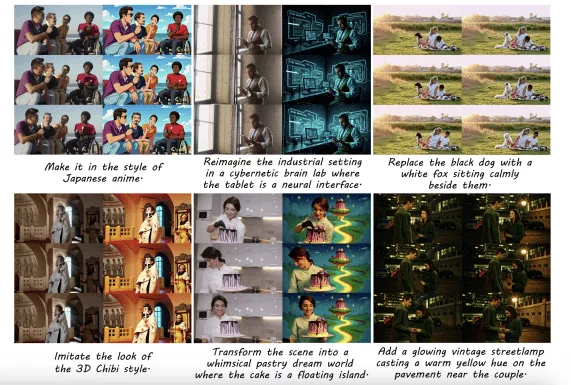

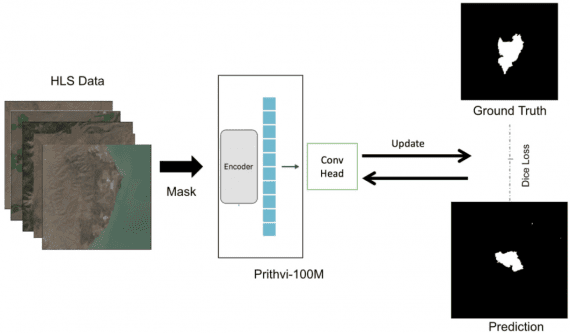

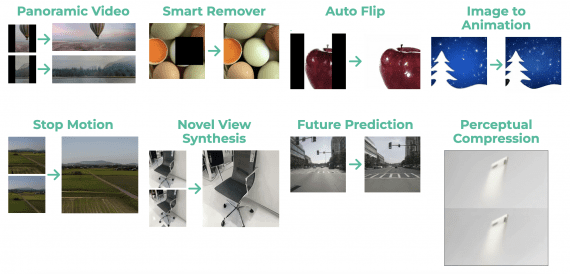

Команда SenseNova представила новую мультимодальную архитектуру SenseNova-U1, которая объединяет понимание изображений, генерацию и редактирование внутри единого трансформера без отдельного визуального энкодера и вариационного автокодировщика. Такой подход убирает необходимость постоянно переводить…