Google представила языковую модель RecurrentGemma, работающую локально на устройствах с ограниченными ресурсами, таких как смартфоны, персональные компьютеры и умные колонки.

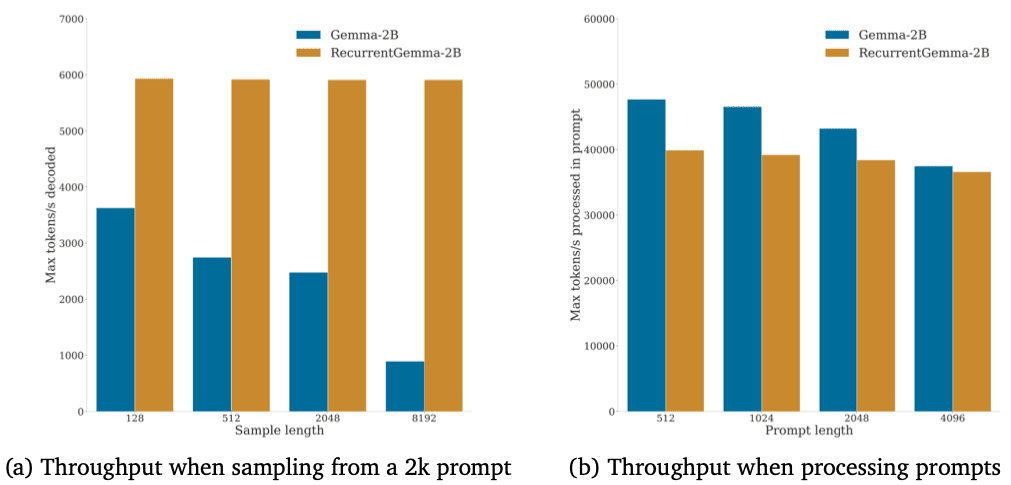

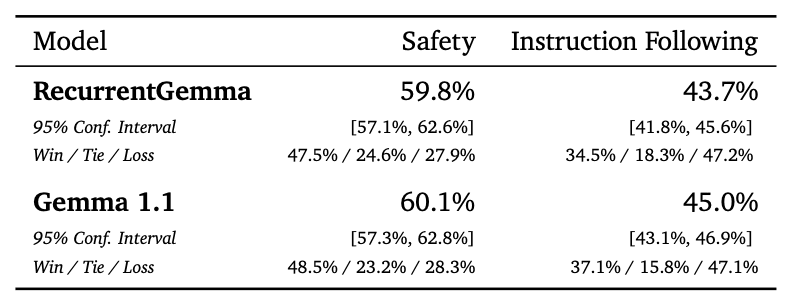

Новая архитектура Google значительно снижает требования к памяти и процессору, сохраняя при этом отличную производительность наравне с большими языковыми моделями. Это позволяет использовать RecurrentGemma в приложениях, требующих реагирования в режиме реального времени, таких как интерактивные системы искусственного интеллекта и службы перевода в режиме реального времени.

Современные языковые модели, такие как GPT-4 от OpenAI, Claude от Anthropic и Gemini от Google, основаны на архитектуре трансформера, которая предполагает увеличение объема памяти и вычислительных потребностей с увеличением объема обрабатываемых входных данных. RecurrentGemma сосредоточена на небольших сегментах входных данных в любой момент времени и не рассматривает всю информацию параллельно, что дает возможность обрабатывать длинные текстовые последовательности без необходимости хранить и анализировать большие объемы промежуточных данных.

Модель основана на линейных рекуррентах, ключевом компоненте традиционных рекуррентных нейронных сетей. Они работают, поддерживая скрытое состояние, которое обновляется по мере обработки каждой новой единицы данных, эффективно “запоминая” предыдущую информацию в последовательности.

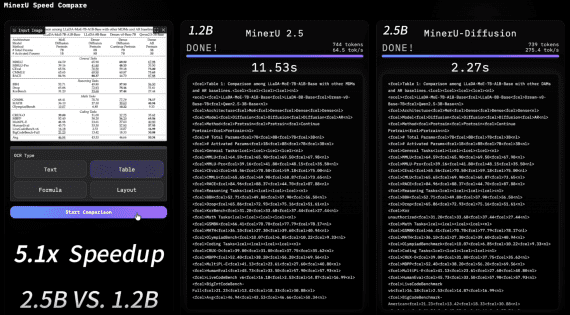

Предобученная модель содержит два миллиарда параметров и опубликована в открытом доступе.