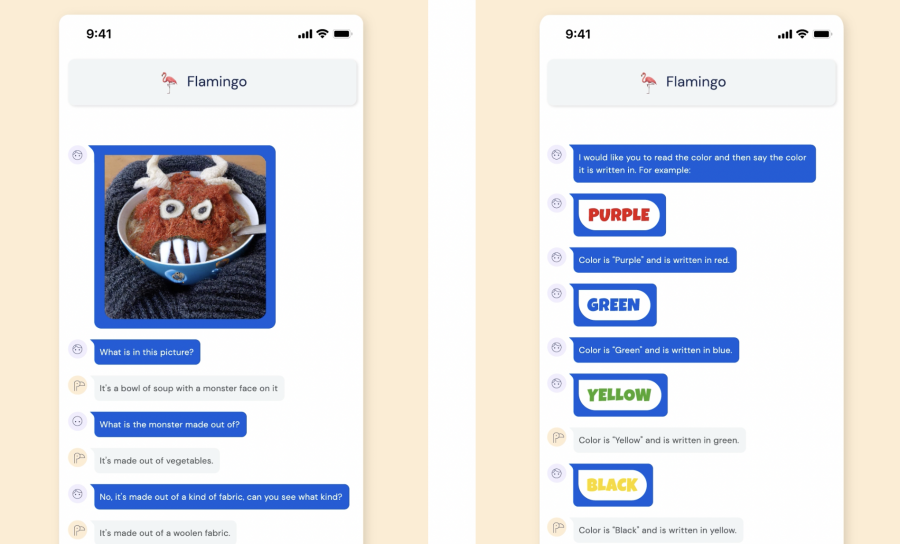

Flamingo – мультимодальная модель DeepMind, генерирующая текстовое описание фото, видео и звуков. Модель превосходит предыдущие state-of-the-art модели в 16 задачах, а ее особенностью является возможность обучаться на нескольких примерах.

Обычно для того, чтобы визуальная модель освоила новую задачу, она должна быть обучена на десятках тысяч примеров, специально размеченных для этой задачи. Если цель состоит в том, чтобы подсчитать и идентифицировать животных на изображении, нужно было бы собрать тысячи изображений животных с указанием их количества и вида. Этот процесс неэффективен, дорог и ресурсоемок, требует больших объемов размеченных данных и необходимости обучать новую модель каждый раз, когда она сталкивается с новой задачей.

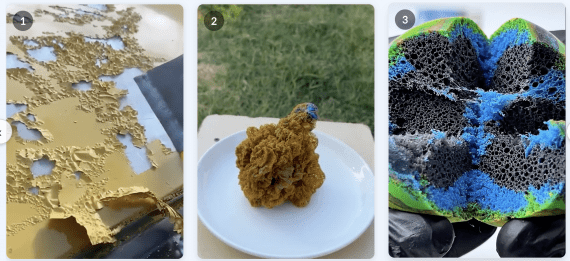

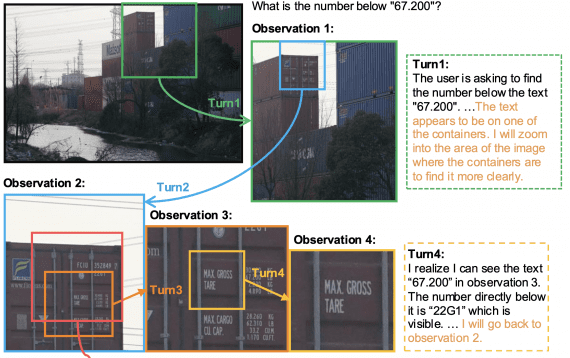

Flamingo – few-shot-модель, которая решает данную проблему в широком спектре мультимодальных задач. На основе нескольких примеров пар визуальных входных данных и ожидаемых текстовых ответов, модели можно задать вопрос с новым изображением или видео, а затем сгенерировать ответ.

В 16 задачах c 4 парами примеров, на которых была протестирована Flamingo, модель обошла все предыдущие state-of-the-art подходы. Во Flamingo объединяются большие языковые модели, визуальные представления (каждое из которых было предварительно обучено), и разработанные в DeepMind архитектурные компоненты между ними. Затем модель обучается на смеси дополнительных неразмеченных крупномасштабных мультимодальных данных из Интернета.